以前の記事で OpenCode・ローカルLLM を試してみましたが、今回は 商用LLM を試していきます。

※ 2026年2月時点の情報になります。

LLM API の料金比較

主要な LLM API サービスの料金比較:

| ベンダ | モデル | 料金(1Mトークンあたり、入力/出力) | 無料枠 |

|---|---|---|---|

| OpenAI | GPT-5.2 | $1.75/$14.00 | 1M* |

| OpenAI | GPT-5 mini | $0.25/$2.00 | 10M* |

| Gemini 3 Pro Preview | $2/$12 | なし | |

| Gemini 2.5 Pro | $1.25/$10 | あり* | |

| Gemini 2.5 Flash | $0.3/2.5 | あり* | |

| Gemini 2.5 Flash Lite | $0.1/0.4 | あり* | |

| Anthropic | Claude Opus 4.5 | $5/$25 | なし |

| Anthropic | Claude Haiku 4.5 | $1/$5 | なし |

無料枠について

OpenAI 及び Google が提供するモデルには無料枠があり、どちらもベンダも API リクエストをモデル改善に利用することで、無料枠を利用することができます。業務などで秘匿情報を扱っている場合、無料枠を使用するのはやめておきましょう。

OpenAI

入出力の共有に同意することで、以下のモデルが 1M/day もしくは 10M/day まで無料で利用できます。(2026年2月時点)

1M token group(usage tiers 1-2 は 250K):

- gpt-5-codex

- gpt-5-2025-08-07

- gpt-5-chat-latest

- gpt-4.5-preview-2025-02-27(deprecated、7/14/25 に終了)

- gpt-4.1-2025-04-14

- gpt-4o-2024-05-13

- gpt-4o-2024-08-06

- gpt-4o-2024-11-20

- o3-2025-04-16

- o1-preview-2024-09-12

- o1-2024-12-17

10M token group(usage tiers 1-2 は 2.5M):

- gpt-5-mini-2025-08-07

- gpt-5-nano-2025-08-07

- gpt-4.1-mini-2025-04-14

- gpt-4.1-nano-2025-04-14

- gpt-4o-mini-2024-07-18

- o4-mini-2025-04-16

- o1-mini-2024-09-12

- codex-mini-latest

Gemini 3 系モデルは無料枠がありませんが、2.5 系は入出力を共有する& Google Cloud プロジェクトを紐づけることで無料で利用することができます。(有効な請求先アカウントが紐づいていない Google Cloud プロジェクトで、API が利用できます。)

Google 公式サイト上で無料枠についての明確な仕様が記載されているページは見つけられませんでした。このあたりはビジネス状況に応じて動的に変更したいところかと思いますので、あえてマニュアルに示していないのかなと想像しています。

APIキーを作成すると以下のようにレート制限についてのページが参照できますので、そのページの情報が無料枠に関する最新情報と判断しています。

こちらは、課金を有効にしていないプロジェクトを紐づけて作成したAPIキーです。枠はモデルによって異なりますが、Gemini 2.5 Flash の場合は以下のように設定されているようです。リクエスト数上限が1日につき20回は結構制限厳しいですね。。。Pro は無料では使えないようです。

- 1分あたりリクエスト数(RPM)

- 5回/分

- 1分あたり入力トークン数(TPM)

- 250トークン/分

- 1日あたりリクエスト数(RPD)

- 20回/日

Gemini 2.5 を OpenCode から使ってみる

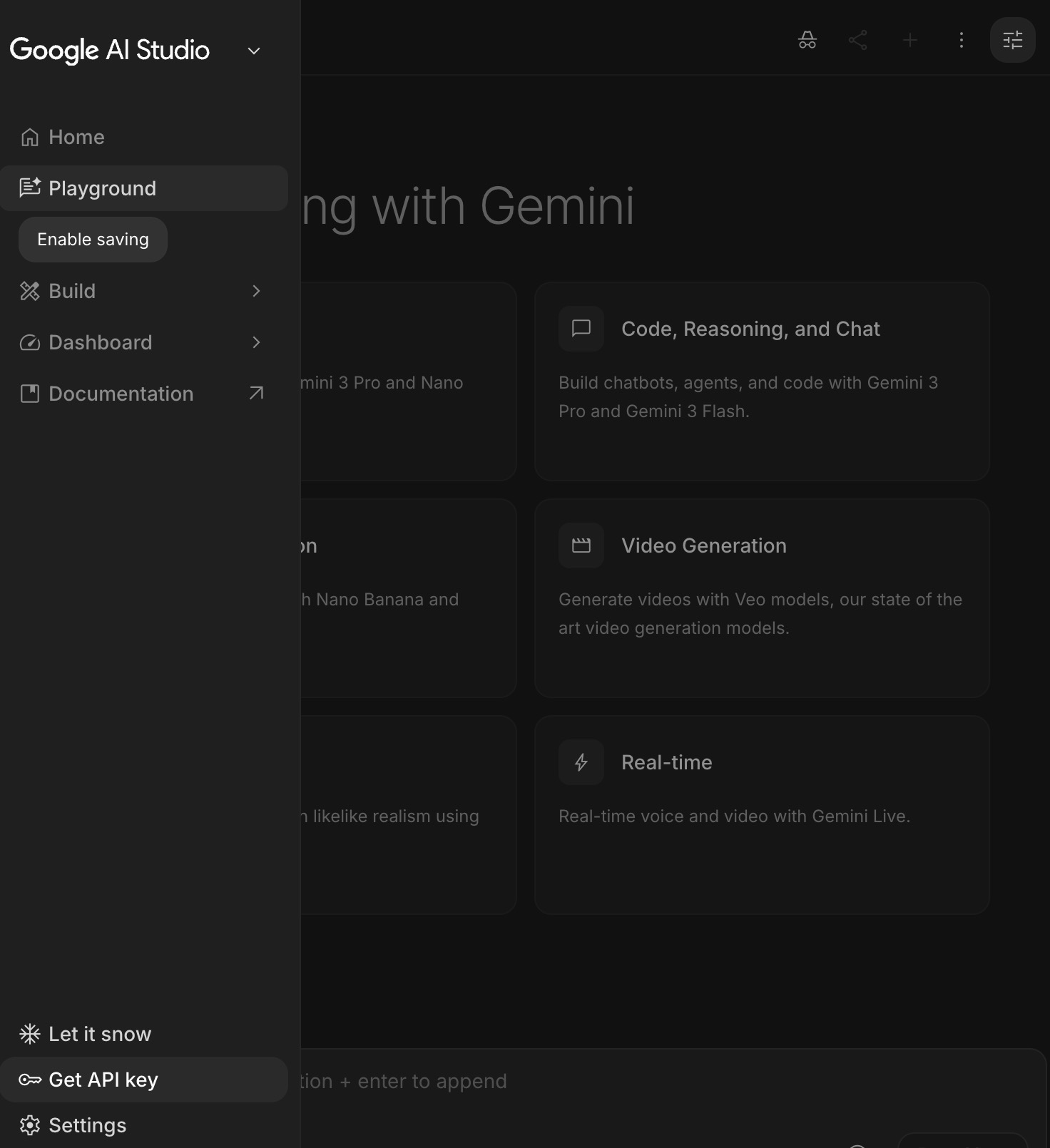

こちらのページから API キーを作成します。

左上メニューから Get API Key を選択します。

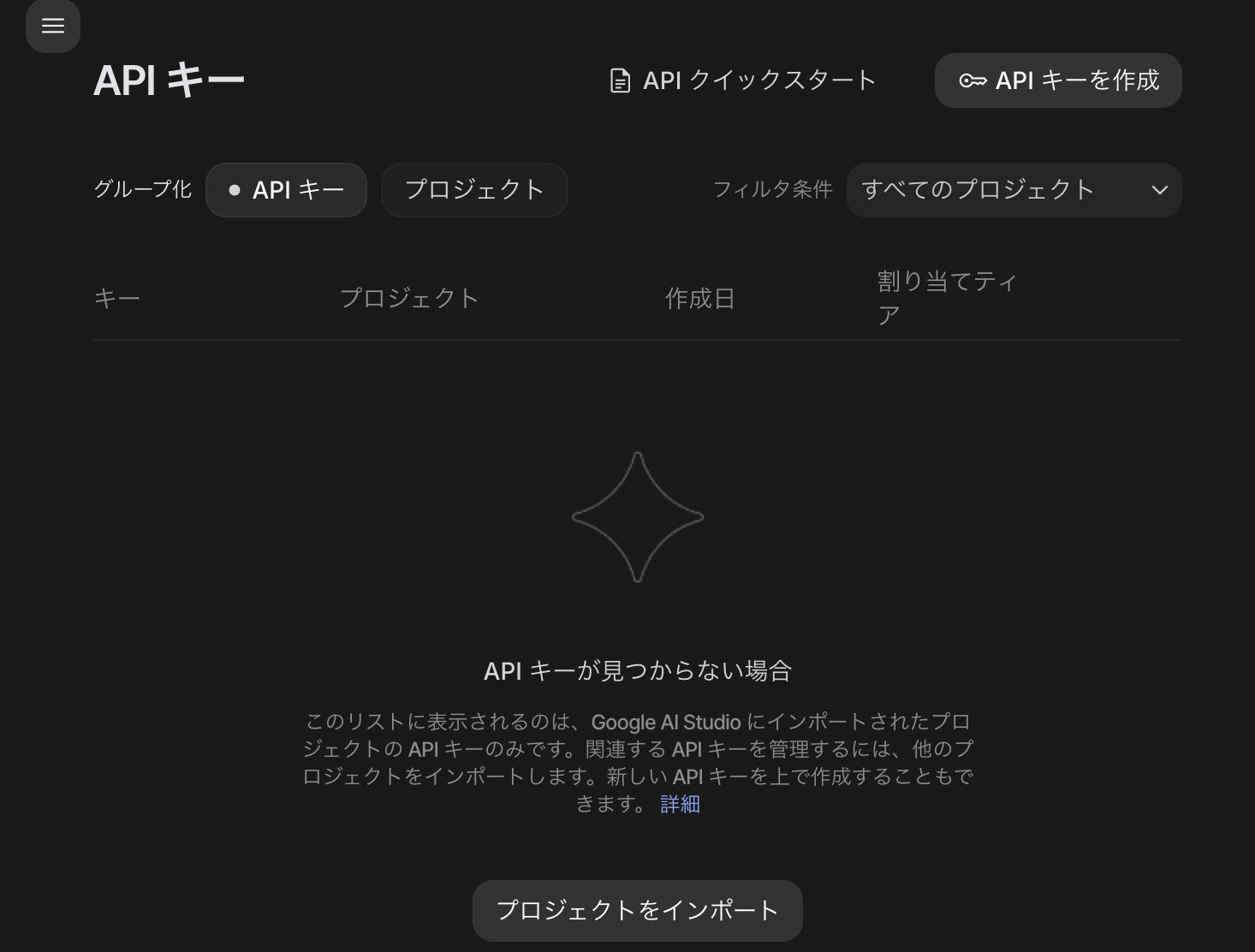

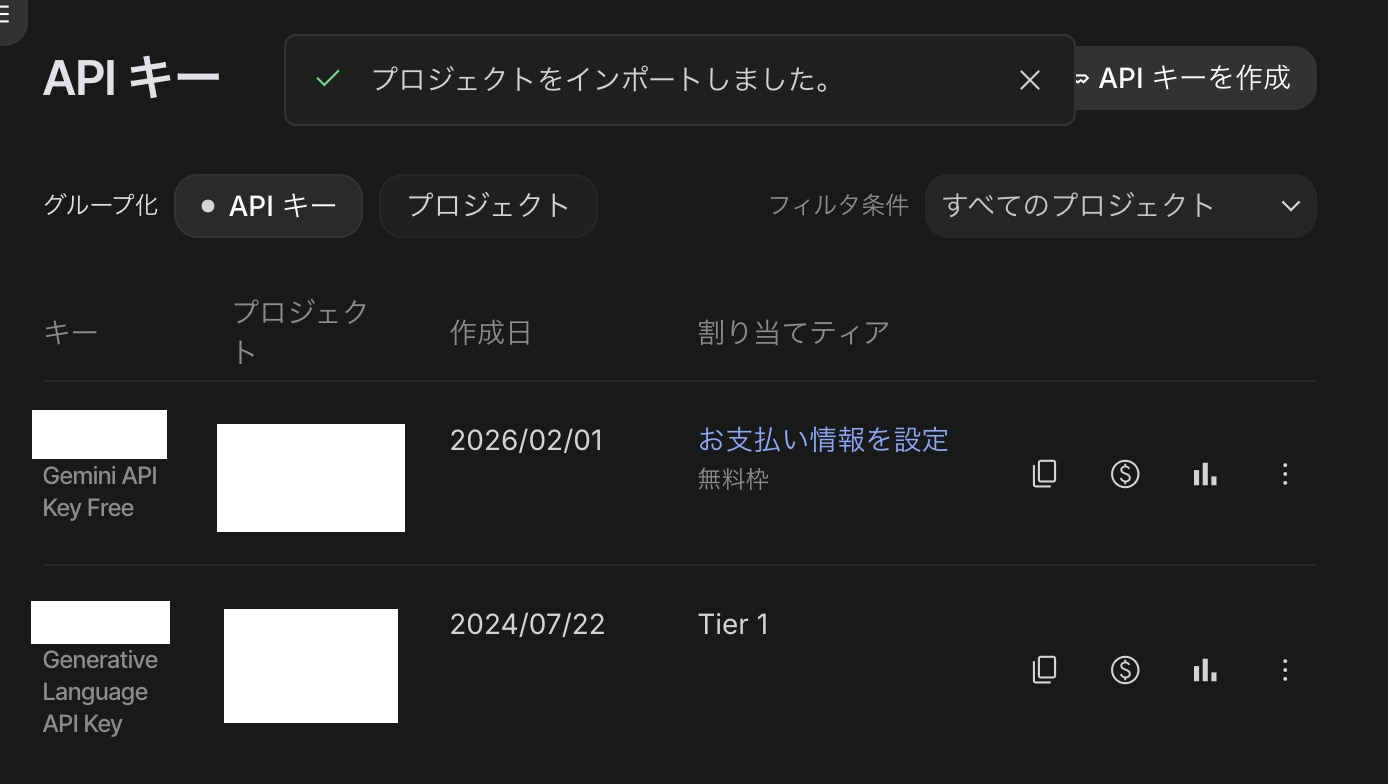

先述の通り、Google Cloud プロジェクトが必要であるため、あらかじめ作っておきましょう。プロジェクト作成後、APIキー発行画面でインポートを実行します。

今回は請求先アカウントが紐づいているプロジェクトでも作ってみました。その場合は Tier 1 として発行されるようです。

これで API キー発行完了です。次に OpenCode で Gemini の設定と動作確認を行います。

# 環境変数の設定

export GOOGLE_GENERATIVE_AI_API_KEY="your-api-key-here"

設定ファイル(~/.opencode/config.yaml):

~/.config/opencode/opencode.json

{

"$schema": "https://opencode.ai/config.json",

"plugin": ["opencode-gemini-auth@latest"],

"provider": {

"google": {

"models": {}

},

}

}

モデルが利用可能か確認します。 起動後 /models と打って gemini の適当なモデルを選択しましょう。

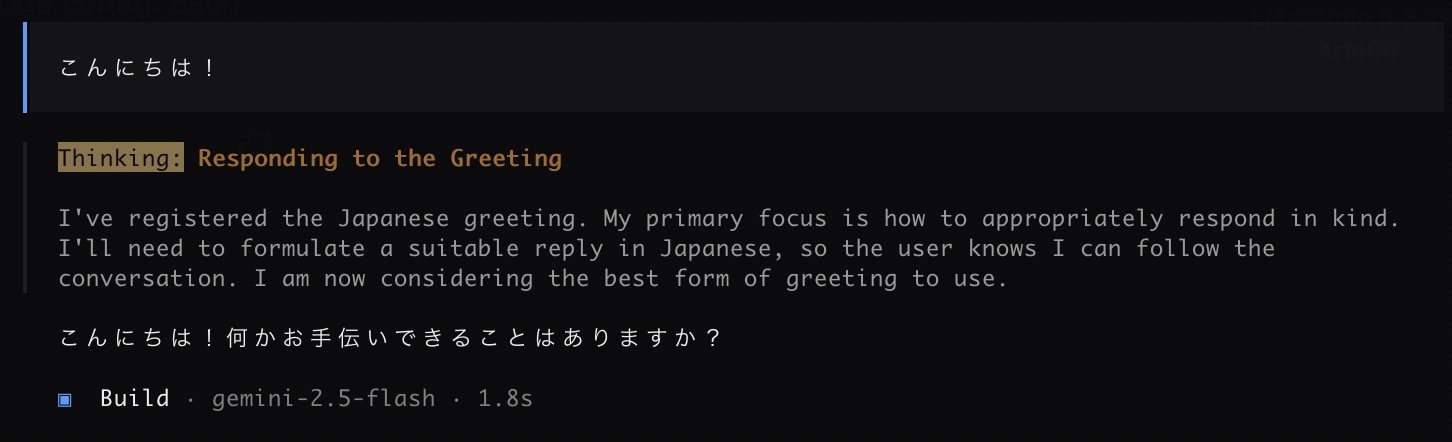

OpenCode から Gemini が使えました!

追記: Gemini CLI を試す

設定後、しばらく OpenCode で Gemini 無料枠を使っていたのですが、すぐに API 制限に引っかかってしまいました。

You exceeded your current quota, please check your plan and billing details. For more information on this error, head to: https://ai.google.dev/gemini-api/docs/rate-limits. To monitor your current usage, head to: https://ai.dev/rate-limit.

* Quota exceeded for metric: generativelanguage.googleapis.com/generate_content_free_tier_input_token_count, limit: 0, model: gemini-2.5-pro

* Quota exceeded for metric: generativelanguage.googleapis.com/generate_content_free_tier_requests, limit: 0, model: gemini-2.5-pro

* Quota exceeded for metric: generativelanguage.googleapis.com/generate_content_free_tier_requests, limit: 0, model: gemini-2.5-pro

* Quota exceeded for metric: generativelanguage.googleapis.com/generate_content_free_tier_input_token_count, limit: 0, model: gemini-2.5-pro

Please retry in 43.211532878s.

OpenCode 上では Gemini 2.5 Flash Lite を指定していたのですが、エラーメッセージ上は Gemini 2.5 Pro が呼ばれていたり、使用状況のページではなぜか Gemini 3 Flash がコールされている履歴があり。。。

特定のモデルを使用しないようにするオプションがないかなと調べてみたのですが、現時点ではなさそうで、以下のような issue も起票されています。

とりあえず現時点の OpenCode では Gemini 完全無料プランを使用するのはうまく機能しないように思われるので、Gemini CLI を試してみましょう。

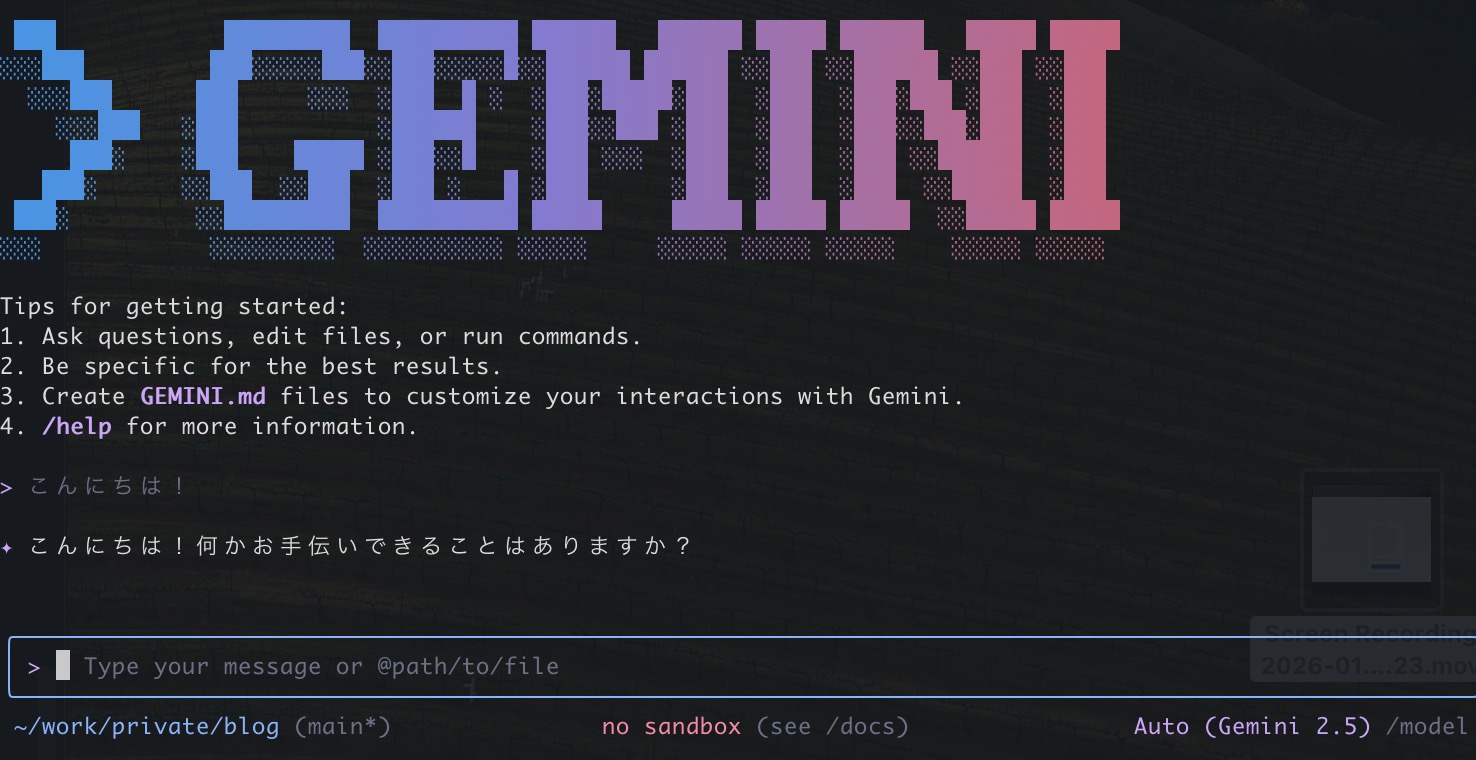

自分の環境は Mac なので brew でインストールします。

brew install gemini-cli

Gemini CLI で Gemini API Key を指定します。マニュアルにも記載がありますが、OpenCode の場合と違って以下の環境変数にキーを指定します。

export GEMINI_API_KEY="your-api-key-here"

起動

gemini

Gemini CLI で無料枠が使えました! とりあえず Gemini API 無料枠を使いたい場合は Gemini CLI で使ってみることにします。